Depositphotos

У NVIDIA заявили, що завдяки використанню ШІ скоротили процес проєктування мікросхем з 10 місяців до однієї ночі.

Як зазначив головний науковий співробітник NVIDIA Білл Дейлі у розмові з колегою з Google Джеффом Діном у рамках GTC-2026, компанія вже використовує ШІ у кількох етапах внутрішнього проєктування мікросхем. За словами Дейлі, NVIDIA використовує ШІ для аналізу варіантів дизайну, роботи з бібліотеками стандартних осередків, обробки помилок та верифікації. При цьому він підкреслив, що про повністю автономне проєктування мікросхем говорити ще зарано.

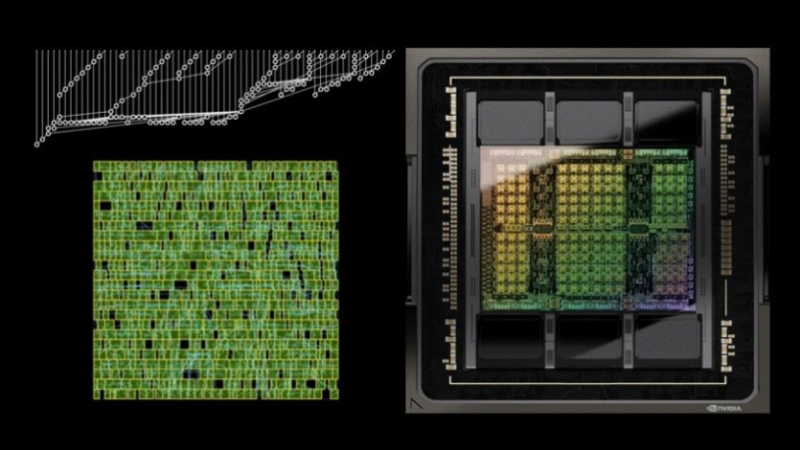

Як приклад Дейлі згадав інструмент NVIDIA NB-Cell. Він пояснив, що перенесення стандартної бібліотеки осередків у новий напівпровідниковий техпроцес раніше займало в команди з 8 співробітників близько 10 місяців. Однак інструмент на базі ШІ з підкріпленням тепер виконує цю роботу за одну ніч на одному графічному процесорі. Отримані осередки відповідають або навіть перевершують розроблені людьми за розміром, енергоспоживанням та затримкам.

Префікс RL / NVIDIA

Дейлі підкреслив, що через це компанія намагається використовувати ШІ всюди, де це можливо. Він також згадав ще один внутрішній інструмент на базі штучного інтелекту prefix RL, який вирішує давню проблему розміщення етапів прогнозування в ланцюжку прогнозування перенесення. Головний науковий співробітник NVIDIA заявив, що ШІ створює схеми, які не змогла б придумати жодна людина. При цьому ключові характеристики покращуються приблизно на 20-30% порівняно з проєктами, розробленими людьми.

Дейлі уточнив, що NVIDIA використовує внутрішні моделі LLM під назвами Chip Nemo та Bug Nemo, створені на базі власних розробок компанії. Моделі були покращені на матеріалах NVIDIA, включно з RTL-документацією та базою даних архітектур GPU, зібраними за роки роботи.

Молодші інженери можуть питати в LLM як працює той чи інший блок, замість того, щоб постійно звертатись до старших колег. Система також узагальнює повідомлення про помилки та класифікує їх відповідно до модулів або інженерів.

Раніше ми писали, що Neural Texture Compression від NVIDIA скорочує VRAM з 6,5 ГБ до 970 МБ без втрат якості. NVIDIA інвестує рекордні $26 млрд у відкриті ШІ-моделі.

Хочеш знати більше, ніж ChatGPT 5? Підписуйся на ITC.ua у TelegramПІДПИСАТИСЯ

СпецпроєктиВесняний апгрейд: 10 гаджетів Canyon, на які варто звернути увагуКоли монтаж починає “задихатися”: яку відеокарту обрати у 2026 році?